-

振东集团的”本草革命”:让中药材跳出药罐子,闯出大健康新天地

发布时间:2025/06/10

红球纷飞传三晋,大爱无边漫九州。5月25日,由中国红十字会总会主办,山西振东健康产业集团赞助的“红气球挑战赛”(晋中站)在山西省高校新区(山西大学城)鸣笛开赛。该赛事汇聚了来自全国各地及山西大学城高校的...

-

2025中美领衔世界级艺术名家 ——赵玉林精品展播

发布时间:2025/01/17

赵玉林,笔名三友,内蒙古包头市美术家协会副主席,草原书画院院长,中国美协内蒙古分会会员,台北故宫书画院名誉院长,中华国礼书画家,国家博物馆画廊特邀书画家。作品入选《中国当代国际书画家年鉴》,在中国书画研究...

-

腾讯创作者生态的前车之鉴,能否支撑《元梦之星》逐梦UGC?

发布时间:2023/09/24

近期,腾讯以“天美乐园”的特别形式公布了新作《元梦之星》,宣告正式入主派对游戏赛道。过去,派对游戏在国内市场份额较小,直到《糖豆人》《香肠派对》《蛋仔派对》等作品引发用户和市场的高度关注,整个赛道才...

-

普悦智能,专注净水,为渠道经销搭载新引擎!

发布时间:2023/08/28

稳步推进:祝贺普悦智能(北京联营公司)第一轮股东入股签约圆满成功! 2023年8月18日,浙江普悦智能科技有限公司北京联营公司——北京普悦京允智能科技有限公司在总经理宋玉财的热忱推进下,成功签约了五名销售/服...

-

英国与快速反应小组一起抗击冠状病毒

发布时间:2020/04/01

英国政府宣布了新的措施,以打击虚假的COVID-19在线信息的传播,包括建立专门的专家小组来处理错误信息。 新成立的快速反应小组将在英国内阁办公室内部运作,并将研究应对互联网上“有害叙述”的方法-解决“...

-

微软即将吸引消费者-但Skype仍将保留

发布时间:2020/03/31

微软今天宣布,今年晚些时候,它将推出Teams的基本消费版,即类似于Slack的文本,音频和视频聊天应用程序。就像Microsoft所喜欢的,您的个人生活团队将使用许多工具,这些工具将使家庭和小组更轻松地组织...

-

安全漏洞暴露了共和党选民公司的内部应用代码

发布时间:2020/03/31

一家专供共和党政治运动使用的选民联系和拉票公司,错误地在其网站上留下了未经保护的应用程序代码副本,供任何人找到。 Campaign Sidekick公司通过iOS和Android应用程序帮助共和党竞选活动布署其选区,这...

-

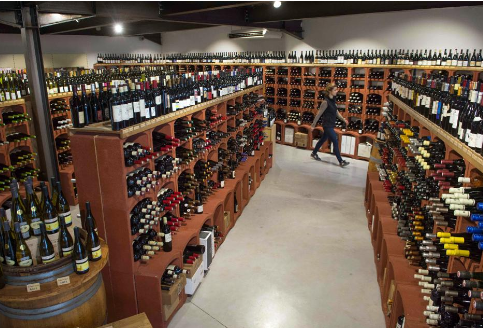

在宾夕法尼亚州,州酒商店仍然关闭,人们越来越口渴

发布时间:2020/03/31

随着美国人渴望长时间的自我隔离,白酒业务的销量激增。根据尼尔森(Nielsen)的数据,到3月中旬,这一增长已经比去年同期高出26%以上。但是,联盟中至少有一个州与这种趋势背道而驰,而且与消费者的意愿无...

白宫的新AI原则无法解决监管问题

发布时间:2020/01/13 新闻 浏览次数:905

本周,白宫发布了10条AI原则,旨在为联邦机构考虑如何适当监管私营部门中的AI提供指导。这是为了减少AI的潜在危害,这种危害已受到全世界的关注,同时又保持了对社会的最大利益。在美国政府控制这一强大技术并确保其不会给人们带来的伤害超过其计划的不确定性的过程中,业界一直在等待这一刻。

但是,尽管白宫在规范AI的斗争中发挥积极作用可能是一件好事,但特朗普政府对轻触式监管的强调意味着新规则还远远不够。

这些原则本身解决了AI伦理界和研究技术对社会影响的学者提出的一些问题。一项这样的原则要求立法者考虑该技术是否会“在现实世界中产生歧视性结果的偏见”,呼应多年来警告学术界人工智能将人工智能将现有社会偏见编入自动化决策系统的学者的呼声。事实证明,这些制度会对社会上最弱势的人产生不利影响,包括那些由于种族,性别,性取向和残疾而受到歧视而被边缘化的人,也许最令人震惊的是,我国最贫穷的公民。不受管制的算法可以自动化,从而控制诸如医疗保健等领域的生命权,在算法方面的缺陷已表明,与白人相比,黑人患者得到的护理不足。在其他情况下,立法者怀疑,算法上的偏见可能会使获得金融信贷和就业机会方面的性别差异长期存在。

该指南还承认,“在创建可解释的AI方面当前存在的技术挑战可能使各机构难以确保必要的透明度,以增强公众的信任。”它建议机构以两种形式追求透明度:公开何时何地使用该技术以及使结果足够透明以确保算法至少符合现有法律。

但是,由于商业秘密的指定以及政府倾向于诉诸Glomar的回应,AI在全球范围内真正危害的真实程度常常被掩盖了-经典的“我既不能确认也不能拒绝”这一说法。使用这些保护措施,实体可以隐藏其使用的与AI相关的程序和产品的范围和广度。很可能已使用的许多算法都违反了现有的反歧视法律(以及其他法律)。在某些情况下,公司甚至可能选择“黑匣子”模型类型,这些模型类型掩盖了大规模决策背后的基本原理,以便声称无知和缺乏对所采取措施的控制。这种法律漏洞是可能的,因为某些类型的AI非常复杂,以至于没有人能真正理解特定决策背后的逻辑,因此如果出现问题,很难归咎于他人。

缺乏透明度导致当今公众对技术行业的信任度大大下降,这进一步证明,迫切需要针对AI的特定法规来保护公共利益。我们一次又一次地看到,即使有最好的意图,人工智能也有可能伤害大量的人,这给该领域带来了独特的责任。这种令人难以置信的大规模伤害能力意味着AI行业中的我们所有人都有责任将社会利益置于利润之上。不幸的是,目前很少有公司体现出这种高度的责任感。

减轻偏见,公开披露以及解决问题性“黑匣子”的方法,对于任何足够有效的AI监管框架而言,都是至关重要的。但是,政府的AI原则在优化社会利益与该技术可能造成的任何潜在危险(现在或以后)之间的平衡时,都远远不够。

取而代之的是,《 AI原则》主要侧重于在电力竞争,市场竞争和经济增长方面失败的风险。在这样做时,政府大大低估了美国人今天所面临的持续伤害,再次牺牲了公众的福祉,以实现不受限制的行业增长。

重要的是,尽管这是联邦政府提出的第一个指导方针,但许多城市和州在管理AI方面已经取得了成功,而类似的,全面的联邦法案由于国会的僵局而陷入僵局或失败。几个城市已禁止执法人员使用侵入式面部识别技术,州和城市级别正在考虑以算法为中心的更多提议。

这说明新的AI原则一口气警告了监管“超范围”,同时又一口气损害了地方立法权。该指南建议各机构可以使用“他们的权力来处理不一致,繁重和重复的州法律。”这种语言巧妙地向立法者表明,一种被称为联邦先发制人的做法可以用来消除某些强大的,草根的,广受赞誉的做法。 AI专家和公民自由倡导者(如ACLU)拥护的地方法规。

更令人担忧的是,这些强有力的地方法律是公众民主意愿的结果,这种意愿表达在最常从事技术工作的国家/地区:旧金山;马萨诸塞州的索默维尔(麻省理工学院附近);以及在华盛顿州西雅图市提出的建议。颁布这些新的当地法律是对使用预测技术来控制敏感服务(如公共住房,主动式医疗保健,金融信贷和就业)的内在风险以及华盛顿缺乏行动的固有对策。开发这些技术的人知道,任何威胁到永久性人类偏见或提供“数学洗礼”以区别对待的算法都必须受到严密监视,以防其行为不端,或者甚至从不实施。

这些AI原则可能是朝正确方向迈出的一小步,从广义上讲,如果认真寻求降低风险的立法者正确实施这些原则,它们可能会带来一定程度的责任增强。但是,这只是一个起点,它们通过提出联邦先发制人的威胁,威胁到进一步的损害,这可能使当地立法者已经开展的令人难以置信的工作蒙上阴影。直接了解人工智能的好处和风险的行业工人通常是要求严格监管的最强烈声音,白宫应采取措施,使其政策更好地与最努力将人工智能推向市场的人的建议保持一致。

莉兹·奥沙利文(Liz O’Sullivan)是ArthurAI的共同创始人,也是STOP(监视技术监督项目)的技术总监。

上一篇: 微软将目光投向总部大楼附近的新办公楼

下一篇: ProBeat:智能扬声器并非智能家居