-

振东集团的”本草革命”:让中药材跳出药罐子,闯出大健康新天地

发布时间:2025/06/10

红球纷飞传三晋,大爱无边漫九州。5月25日,由中国红十字会总会主办,山西振东健康产业集团赞助的“红气球挑战赛”(晋中站)在山西省高校新区(山西大学城)鸣笛开赛。该赛事汇聚了来自全国各地及山西大学城高校的...

-

2025中美领衔世界级艺术名家 ——赵玉林精品展播

发布时间:2025/01/17

赵玉林,笔名三友,内蒙古包头市美术家协会副主席,草原书画院院长,中国美协内蒙古分会会员,台北故宫书画院名誉院长,中华国礼书画家,国家博物馆画廊特邀书画家。作品入选《中国当代国际书画家年鉴》,在中国书画研究...

-

腾讯创作者生态的前车之鉴,能否支撑《元梦之星》逐梦UGC?

发布时间:2023/09/24

近期,腾讯以“天美乐园”的特别形式公布了新作《元梦之星》,宣告正式入主派对游戏赛道。过去,派对游戏在国内市场份额较小,直到《糖豆人》《香肠派对》《蛋仔派对》等作品引发用户和市场的高度关注,整个赛道才...

-

普悦智能,专注净水,为渠道经销搭载新引擎!

发布时间:2023/08/28

稳步推进:祝贺普悦智能(北京联营公司)第一轮股东入股签约圆满成功! 2023年8月18日,浙江普悦智能科技有限公司北京联营公司——北京普悦京允智能科技有限公司在总经理宋玉财的热忱推进下,成功签约了五名销售/服...

-

英国与快速反应小组一起抗击冠状病毒

发布时间:2020/04/01

英国政府宣布了新的措施,以打击虚假的COVID-19在线信息的传播,包括建立专门的专家小组来处理错误信息。 新成立的快速反应小组将在英国内阁办公室内部运作,并将研究应对互联网上“有害叙述”的方法-解决“...

-

微软即将吸引消费者-但Skype仍将保留

发布时间:2020/03/31

微软今天宣布,今年晚些时候,它将推出Teams的基本消费版,即类似于Slack的文本,音频和视频聊天应用程序。就像Microsoft所喜欢的,您的个人生活团队将使用许多工具,这些工具将使家庭和小组更轻松地组织...

-

安全漏洞暴露了共和党选民公司的内部应用代码

发布时间:2020/03/31

一家专供共和党政治运动使用的选民联系和拉票公司,错误地在其网站上留下了未经保护的应用程序代码副本,供任何人找到。 Campaign Sidekick公司通过iOS和Android应用程序帮助共和党竞选活动布署其选区,这...

-

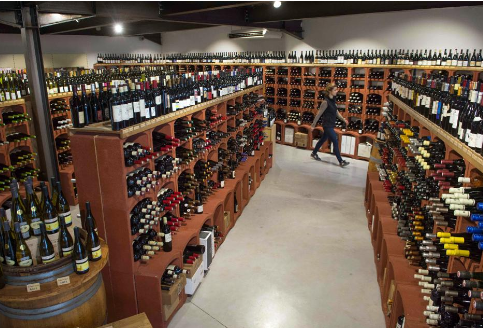

在宾夕法尼亚州,州酒商店仍然关闭,人们越来越口渴

发布时间:2020/03/31

随着美国人渴望长时间的自我隔离,白酒业务的销量激增。根据尼尔森(Nielsen)的数据,到3月中旬,这一增长已经比去年同期高出26%以上。但是,联盟中至少有一个州与这种趋势背道而驰,而且与消费者的意愿无...

Facebook的MoCo弥合了视觉任务中有监督和无监督学习之间的鸿沟

发布时间:2019/11/20 新闻 浏览次数:1108

无监督的表示学习(允许AI系统自动发现分类原始数据所需的表示的一组技术)正在自然语言处理中得到广泛使用。但这尚未在计算机视觉中引起人们的注意,这也许是因为诸如图像分类之类的任务中的原始信号处于连续的高维空间中,而该空间并不适合人类交流。

这促使Facebook的研究人员奉行一种对比性损失法,即从图像数据中采样密钥(或令牌),并由经过培训的编码器表示,该编码器经过训练以将查询与字典进行匹配。为此,他们开发了Momentum Contrast,可以预先训练可通过微调转移到任务的表示形式。在一项涉及七个与检测或分割相关的任务的测试中,以及来自Instagram的约10亿张照片的语料库,他们说,在某些情况下,MoCo超出了监督基准的“非平凡”利润率。

研究人员在一份详细说明他们工作的论文中写道:“这些结果表明,MoCo在许多计算机视觉任务中弥合了无监督和有监督的表示学习之间的差距,并且可以替代…有监督的预训练。”

MoCo巧妙地将上述密钥字典作为数据样本队列进行维护,从而使其能够重用已编码的密钥。这样一来,字典就可以比通常的更大,并且可以“灵活地”和“独立地”设置为超参数(即无需使用观测数据即可估算出的AI模型参数)。从某种意义上来说,这是一本动态词典,其样本会逐渐被替换,但研究人员注意到,它始终代表着所有数据的抽样子集。

为了评估MoCo,团队使用了ImageNet和Instagram-1B,这些数据集分别包含1000个类别的128万张图像和9.4亿个与ImageNet类别相关的公共Instagram图像。 (考虑到它的大小,也许不足为奇,在Instagram语料库上训练图像分类模型花了六天时间和64张图形卡。)他们报告说,在Instagram语料库上进行预训练的MoCo的性能始终优于ImageNet样本,表明它在非常适合大型和相对未整理的数据。

研究人员写道:“ MoCo在很大程度上消除了在多视觉任务中无监督和有监督的表示学习之间的差距。” “除了简单的实例区分任务之外,还可以将MoCo用于诸如掩盖自动编码之类的前置任务,例如在语言和视觉方面。我们希望MoCo在涉及对比学习的其他借口任务中会有所帮助。”